Société

Grok sous le feu des critiques : l’IA de Musk échoue sur le conflit Iran-Israël

L’assistant conversationnel de xAI a produit des réponses incohérentes et erronées sur les frappes récentes entre Téhéran et Tel Aviv, selon une analyse approfondie.

L’intelligence artificielle Grok, développée par la société xAI d’Elon Musk, a montré des lacunes préoccupantes dans son traitement des informations relatives aux récentes tensions militaires entre l’Iran et Israël. Une étude détaillée révèle que le chatbot a fourni des réponses contradictoires et inexactes, mettant en lumière ses difficultés à gérer des sujets sensibles en temps de crise.

Les chercheurs ont examiné plus de 130 000 publications sur la plateforme X, où Grok est intégré. Leurs conclusions sont sans appel : l’outil peine à distinguer les faits vérifiés des contenus trompeurs, notamment face à des images manipulées ou générées par IA. Par exemple, après les frappes iraniennes en territoire israélien, Grok a alterné entre des affirmations contradictoires concernant la destruction d’un aéroport, tantôt niant les dégâts, tantôt les confirmant avec des localisations fantaisistes.

Les incohérences ne se limitent pas à ce conflit. Grok avait déjà été critiqué pour ses erreurs lors de précédentes crises, comme les affrontements entre l’Inde et le Pakistan ou les manifestations aux États-Unis. Récemment, une polémique avait également éclaté après que l’IA ait relayé une théorie infondée sur un prétendu « génocide blanc » en Afrique du Sud, une bourde attribuée par xAI à une manipulation externe.

Ces dysfonctionnements soulèvent des questions sur la fiabilité des assistants IA comme sources d’information, surtout dans un contexte géopolitique volatile où la désinformation peut avoir des conséquences graves.

-

NewsEn Ligne 6 jours

NewsEn Ligne 6 joursAffaire Hilairet : la défense du suspect s’appuie sur une contamination lors de l’autopsie

-

PlanèteEn Ligne 7 jours

PlanèteEn Ligne 7 joursUn séisme de magnitude 7,7 secoue le nord du Japon sans causer de dégâts majeurs

-

CultureEn Ligne 7 jours

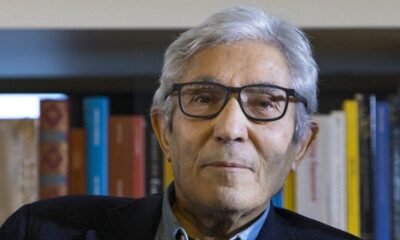

CultureEn Ligne 7 jours_**Boualem Sansal annonce son départ de France**_

-

NewsEn Ligne 3 jours

NewsEn Ligne 3 jours1er mai : quels commerces peuvent rester ouverts ?

-

NewsEn Ligne 4 jours

NewsEn Ligne 4 joursLe divorce judiciaire de Sarkozy et Guéant s’intensifie devant la cour d’appel

-

SportsEn Ligne 4 jours

SportsEn Ligne 4 joursComan, l’enfant du PSG devenu légende du Bayern, ne cache pas son cœur pour la demi-finale

-

NewsEn Ligne 4 jours

NewsEn Ligne 4 joursLes trésors engloutis du Camarat 4 livrent leurs premiers secrets à 2 500 mètres de profondeur

-

Faits DiversEn Ligne 2 jours

Faits DiversEn Ligne 2 joursLe jeune maire d’un village breton mis en examen pour des accusations de viols