Économie

Le Pentagone s’allie à OpenAI après le refus éthique d’Anthropic

L’armée américaine officialise un partenariat avec le créateur de ChatGPT, au lendemain d’une rupture brutale avec son concurrent. La décision fait suite à un désaccord fondamental sur l’usage militaire de l’intelligence artificielle.

Le département de la Défense des États-Unis a scellé un accord avec OpenAI pour intégrer ses modèles d’intelligence artificielle dans ses systèmes classifiés. Cette annonce, faite par le dirigeant de l’entreprise Sam Altman, intervient au terme d’une semaine de tensions vives avec la société Anthropic, désormais écartée des projets militaires. Le différend porte sur les conditions d’emploi des technologies d’IA par les forces armées.

Anthropic avait opposé un refus catégorique à une demande du Pentagone exigeant un accès sans restriction à son modèle Claude. La direction de l’entreprise, par la voix de son président Dario Amodei, avait invoqué des principes éthiques, jugeant inacceptable l’utilisation de l’IA pour la surveillance de masse sur le territoire national ou pour le déclenchement de frappes létales sans contrôle humain ultime. Cette position a provoqué une réaction immédiate de l’exécutif.

L’administration a ordonné la cessation de toute collaboration avec Anthropic, qualifiant son attitude de préjudiciable à la sécurité nationale. Le ministre de la Défense a pour sa part dénoncé une forme de trahison, fustigeant ce qu’il a présenté comme des caprices idéologiques de la part des géants de la tech. La société s’est dite profondément attristée par cette mesure, qu’elle estime juridiquement infondée et dangereuse, et a annoncé son intention de contester la décision en justice.

De son côté, OpenAI affirme que son partenariat avec le Pentagone intègre des garde-fous stricts. L’accord comprendrait notamment l’interdiction explicite de la surveillance de masse domestique et le maintien d’une responsabilité humaine dans les décisions engageant l’usage de la force. Sam Altman a précisé que des garanties techniques seraient mises en œuvre pour encadrer le comportement des modèles, et a indiqué avoir encouragé le ministère à proposer des conditions similaires à toutes les entreprises du secteur.

Fondée par d’anciens membres d’OpenAI, Anthropic a construit son image sur une approche prudemment régulée de l’intelligence artificielle. La start-up avait récemment publié une « constitution » interne visant à orienter les réponses de son modèle Claude vers une dangerosité minimale. Ce cadre éthique est au cœur du conflit qui l’oppose désormais aux autorités américaines, marquant une fracture nette dans l’industrie entre coopération inconditionnelle et principe de précaution.

-

SèteEn Ligne 1 mois

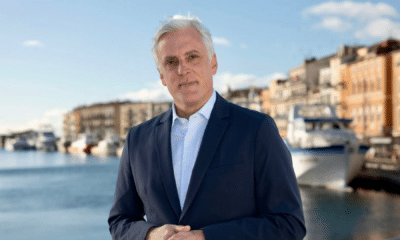

SèteEn Ligne 1 moisSète : Sébastien Denaja dévoile ses mesures pour la sécurité et la tranquillité publique

-

GigeanEn Ligne 1 mois

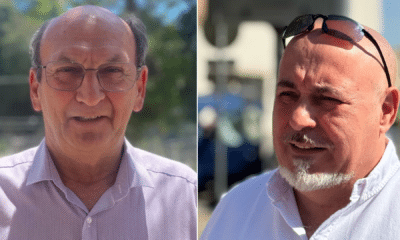

GigeanEn Ligne 1 moisGigean : Marcel Stoecklin, à défaut de projet, le soupçon comme programme

-

Balaruc-le-VieuxEn Ligne 3 semaines

Balaruc-le-VieuxEn Ligne 3 semainesBalaruc-le-Vieux : Aurélien Évangélisti, le candidat qui fait payer la commune pour se défendre

-

Balaruc-le-VieuxEn Ligne 4 semaines

Balaruc-le-VieuxEn Ligne 4 semainesBalaruc-le-Vieux : Fabienne Battinelli présente sa candidature et son projet communal

-

SportsEn Ligne 2 semaines

SportsEn Ligne 2 semainesLe PSG s’offre une finale à Abidjan après une démonstration face au Paris FC

-

SèteEn Ligne 4 semaines

SèteEn Ligne 4 semainesSète : le Parti Animaliste entre officiellement dans la bataille municipale

-

FrontignanEn Ligne 4 semaines

FrontignanEn Ligne 4 semainesFrontignan : Thibaut Cléret Villagordo mise sur la cantine à 1€ pour les familles

-

ThauEn Ligne 1 mois

ThauEn Ligne 1 moisSète Agglopôle Méditerranée : les vœux 2026 annulés sur fond de crise conchylicole