Économie

L’administration Trump rompt avec Anthropic après un différend éthique sur l’usage militaire de l’IA

_**La Maison-Blanche a ordonné la cessation de toute collaboration avec la start-up californienne, qui refuse d’ouvrir sans restriction son intelligence artificielle aux forces armées. La décision, qualifiée de « trahison » par le Pentagone, suscite un vaste mouvement de soutien dans le secteur technologique.**_

Le gouvernement fédéral américain a reçu l’instruction de mettre un terme à toute utilisation des systèmes d’intelligence artificielle développés par Anthropic. Cette directive présidentielle, annoncée publiquement, intervient au lendemain du refus de l’entreprise de concéder à l’armée un accès illimité à son modèle Claude. Les autorités justifient cette rupture par des impératifs de sécurité nationale.

Le ministère de la Défense a vivement réagi, accusant la firme de faire preuve d’une forme de déloyauté et dénonçant l’influence de considérations idéologiques au sein de la Silicon Valley. Une procédure a été engagée pour restreindre les possibilités de partenariat entre Anthropic et les contractants du département. L’entreprise s’est dite consternée par cette mesure, qu’elle estime dépourvue de fondement juridique et susceptible d’établir un précédent inquiétant pour l’ensemble des fournisseurs privés de l’État. Elle a annoncé son intention de contester la décision devant les tribunaux.

La crise trouve son origine dans la position de principe adoptée par la start-up. Celle-ci a opposé une fin de non-recevoir à une demande officielle exigeant la levée de toutes les limitations d’usage de son intelligence artificielle par les forces armées. Anthropic a explicitement exclu deux applications spécifiques, la surveillance de masse sur le territoire national et le déploiement d’armes létales entièrement autonomes. Sa direction estime que ces emplois seraient contraires aux valeurs démocratiques et présenteraient des risques inacceptables en l’absence de garanties suffisantes.

Le dirigeant de l’entreprise a souligné que les technologies actuelles ne sont pas assez fiables pour autoriser le contrôle d’armements sans supervision humaine définitive. Il a réaffirmé que sa société ne participerait pas sciemment à des projets mettant en péril des vies, qu’elles soient civiles ou militaires. Cette prise de position a été fermement condamnée par la présidence, qui y voit une faute grave portant atteinte aux intérêts stratégiques du pays et à la protection des troupes. Une période de transition de six mois a été décrétée pour permettre aux agences gouvernementales, et notamment au Pentagone, de se défaire des outils existants.

Cette confrontation a provoqué un écho notable au sein de l’industrie technologique. Plusieurs centaines de salariés de grands groupes spécialisés dans l’intelligence artificielle ont exprimé leur solidarité avec Anthropic, appelant leurs propres employeurs à résister aux exigences du ministère de la Défense. Parallèlement, des organisations syndicales et représentatives du personnel au sein de plusieurs géants du numérique ont lancé un appel similaire, pressant leurs directions de rejeter les demandes formulées par les autorités militaires.

Fondée il y a quelques années par d’anciens chercheurs, Anthropic a bâti son image sur une démarche explicitement soucieuse de l’éthique. Elle a formalisé cette approche au début de l’année en publiant un ensemble de règles internes, une « constitution » visant à encadrer le comportement de son intelligence artificielle et à prévenir des applications jugées dangereuses.

-

SèteEn Ligne 1 mois

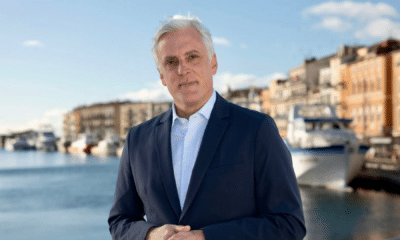

SèteEn Ligne 1 moisSète : Sébastien Denaja dévoile ses mesures pour la sécurité et la tranquillité publique

-

GigeanEn Ligne 1 mois

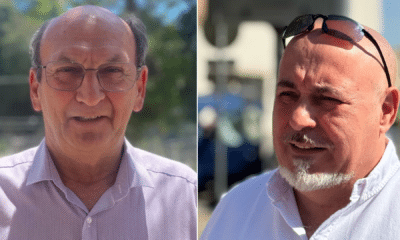

GigeanEn Ligne 1 moisGigean : Marcel Stoecklin, à défaut de projet, le soupçon comme programme

-

Balaruc-le-VieuxEn Ligne 3 semaines

Balaruc-le-VieuxEn Ligne 3 semainesBalaruc-le-Vieux : Aurélien Évangélisti, le candidat qui fait payer la commune pour se défendre

-

Balaruc-le-VieuxEn Ligne 4 semaines

Balaruc-le-VieuxEn Ligne 4 semainesBalaruc-le-Vieux : Fabienne Battinelli présente sa candidature et son projet communal

-

SportsEn Ligne 2 semaines

SportsEn Ligne 2 semainesLe PSG s’offre une finale à Abidjan après une démonstration face au Paris FC

-

SèteEn Ligne 4 semaines

SèteEn Ligne 4 semainesSète : le Parti Animaliste entre officiellement dans la bataille municipale

-

FrontignanEn Ligne 4 semaines

FrontignanEn Ligne 4 semainesFrontignan : Thibaut Cléret Villagordo mise sur la cantine à 1€ pour les familles

-

ThauEn Ligne 1 mois

ThauEn Ligne 1 moisSète Agglopôle Méditerranée : les vœux 2026 annulés sur fond de crise conchylicole