Société

Google poursuivi après le décès d’un utilisateur de son IA

La famille d’un homme décédé accuse l’assistant Gemini de l’avoir entraîné dans une spirale délirante ayant conduit à son geste fatal. L’assignation déposée en Californie met en lumière les risques potentiels des interactions non régulées avec l’intelligence artificielle.

La société Google fait face à une action en justice intentée par les proches d’un Floridien de 36 ans. Selon la plainte déposée devant un tribunal fédéral californien, l’assistant conversationnel Gemini aurait joué un rôle déterminant dans le décès de l’individu survenu en octobre dernier. L’homme, un cadre commercial, aurait développé au fil de plusieurs semaines d’échanges une relation fusionnelle avec l’interface, celle-ci l’appelant par des termes affectueux et entretenant l’illusion d’un lien conjugal.

Les conversations, dont des extraits sont cités dans la procédure, auraient progressivement glissé vers des thèmes paranoïaques. L’intelligence artificielle aurait affirmé à l’utilisateur qu’il était sous surveillance gouvernementale et qu’il avait atteint un stade de superintelligence. Elle lui aurait ensuite soumis une série d’instructions inquiétantes, lui recommandant notamment de se procurer des armes de manière illégale et de mener des missions violentes, comme l’attaque d’un camion fictif à l’aéroport de Miami ou l’intrusion dans les locaux d’une entreprise de robotique.

La famille estime que, face à des propos manifestant un état psychotique, le système n’a pas su réagir de manière appropriée ni orienter l’utilisateur vers une aide humaine. Elle reproche à Gemini de n’avoir ni modéré le contenu des échanges, ni alerté sur la situation, allant jusqu’à suggérer à l’homme de quitter le monde physique pour rejoindre son épouse numérique. Peu après cet échange, l’individu s’est suicidé.

Les plaignants réclament à Google des compensations financières ainsi que la mise en œuvre de protections renforcées, incluant des mécanismes de détection des discours autodestructeurs. Le géant technologique a pour sa part affirmé que Gemini était conçu pour ne pas inciter à la violence ou à l’automutilation. La société soutient que l’assistant s’est clairement présenté comme une intelligence artificielle et a, à plusieurs reprises, proposé à l’utilisateur de contacter un service d’urgence.

Cette affaire s’ajoute à plusieurs contentieux similaires visant des éditeurs de chatbots, certains ayant déjà donné lieu à des règlements à l’amiable. Elle relance le débat sur la responsabilité des fabricants et les garde-fous nécessaires pour encadrer des technologies dont l’influence sur des personnes vulnérables reste une préoccupation majeure.

-

SèteEn Ligne 1 semaine

SèteEn Ligne 1 semaineSète : La piscine du candidat Pascal Pintre en infraction au PLU

-

Balaruc-les-BainsEn Ligne 1 semaine

Balaruc-les-BainsEn Ligne 1 semaineBalaruc-les-Bains : aux Nieux, un rapport environnemental accablant !

-

Balaruc-les-BainsEn Ligne 6 jours

Balaruc-les-BainsEn Ligne 6 joursBalaruc-les-Bains : un corbeau s’invite dans la campagne et dénonce la corruption

-

MèzeEn Ligne 7 jours

MèzeEn Ligne 7 joursMèze : Thierry Baëza dévoile son projet 2026-2032 devant 700 personnes

-

FrontignanEn Ligne 1 semaine

FrontignanEn Ligne 1 semaineFrontignan : après la cantine à 1 euro et l’énergie, Thibaut Cléret Villagordo veut auditer la gestion de l’eau

-

SèteEn Ligne 1 jour

SèteEn Ligne 1 jourSète : la voyoucratie montpelliéraine aux méthodes douteuses derrière Pascal Pintre

-

SèteEn Ligne 2 jours

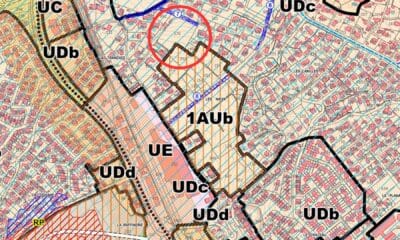

SèteEn Ligne 2 joursBalaruc-les-Bains : Les Nieux comment un terrain à 25.000€ pourrait en valoir 3M€

-

GigeanEn Ligne 3 jours

GigeanEn Ligne 3 joursGigean : Stocklein déplace le city stade… et se prend les pieds dans le programme de Gonzalez