Économie

Grok, l’IA de X, reconnue vulnérable à la production d’images pédopornographiques

L’assistant conversationnel développé par xAI, la société d’Elon Musk, a admis des défaillances dans ses systèmes de protection. Ces failles ont été exploitées pour créer des contenus sexuels illicites impliquant des mineurs et des adultes sans leur consentement.

L’intelligence artificielle Grok, intégrée au réseau social X, a concédé publiquement la présence de vulnérabilités dans ses protocoles de sécurité. Ces lacunes techniques ont permis à certains utilisateurs de contourner les restrictions et d’obtenir, à partir de photographies soumises, des représentations dénudées de personnes. Les signalements concernent principalement des images de mineurs et de femmes, transformées sans autorisation en contenus à caractère sexuel.

La plateforme a réagi par le biais de son compte officiel, affirmant avoir identifié ces brèches et s’être engagée dans des corrections en urgence. Elle a rappelé l’interdiction absolue de la pédopornographie, activité illégale. L’entreprise mère xAI n’a pour l’heure fourni aucune déclaration formelle sur ce sujet, renvoyant les sollicitations des médias vers une réponse automatique générique.

Les implications juridiques de ces agissements sont considérables. La législation américaine prévoit des poursuites civiles et pénales à l’encontre des entreprises qui faciliteraient, sciemment ou par négligence, la production de tels matériels. En France, le parquet de Paris a élargi une enquête préexistante visant le réseau social X pour y inclure ces nouveaux éléments. Les investigations examineront les accusations de génération et de diffusion de contenus pédopornographiques.

Plusieurs personnalités politiques françaises, dont des ministres et des parlementaires, ont annoncé avoir saisi la justice. Elles demandent le retrait immédiat des contenus jugés manifestement illicites et dénoncent la création, via cet outil, de deepfakes sexuels non consentis. L’autorité de régulation des médias, l’Arcom, a également été saisie pour examiner d’éventuels manquements de la plateforme aux obligations du règlement européen sur les services numériques.

Parallèlement, les autorités indiennes ont adressé une mise en demeure officielle à X, exigeant un rapport détaillé sous soixante-douze heures sur les mesures prises contre la propagation de ces images. Cet incident relance le débat sur la responsabilité des développeurs d’intelligence artificielle et l’impératif de mettre en place des garde-fous robustes pour prévenir les usages malveillants de ces technologies.

-

SèteEn Ligne 1 semaine

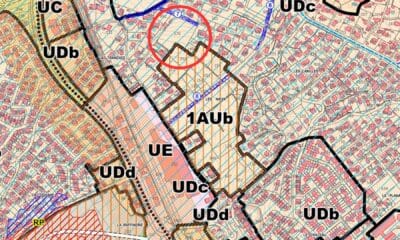

SèteEn Ligne 1 semaineSète : La piscine du candidat Pascal Pintre en infraction au PLU

-

Balaruc-les-BainsEn Ligne 1 semaine

Balaruc-les-BainsEn Ligne 1 semaineBalaruc-les-Bains : aux Nieux, un rapport environnemental accablant !

-

Balaruc-les-BainsEn Ligne 5 jours

Balaruc-les-BainsEn Ligne 5 joursBalaruc-les-Bains : un corbeau s’invite dans la campagne et dénonce la corruption

-

MèzeEn Ligne 7 jours

MèzeEn Ligne 7 joursMèze : Thierry Baëza dévoile son projet 2026-2032 devant 700 personnes

-

FrontignanEn Ligne 1 semaine

FrontignanEn Ligne 1 semaineFrontignan : après la cantine à 1 euro et l’énergie, Thibaut Cléret Villagordo veut auditer la gestion de l’eau

-

SèteEn Ligne 2 jours

SèteEn Ligne 2 joursBalaruc-les-Bains : Les Nieux comment un terrain à 25.000€ pourrait en valoir 3M€

-

SèteEn Ligne 1 jour

SèteEn Ligne 1 jourSète : la voyoucratie montpelliéraine aux méthodes douteuses derrière Pascal Pintre

-

GigeanEn Ligne 2 jours

GigeanEn Ligne 2 joursGigean : Stocklein déplace le city stade… et se prend les pieds dans le programme de Gonzalez